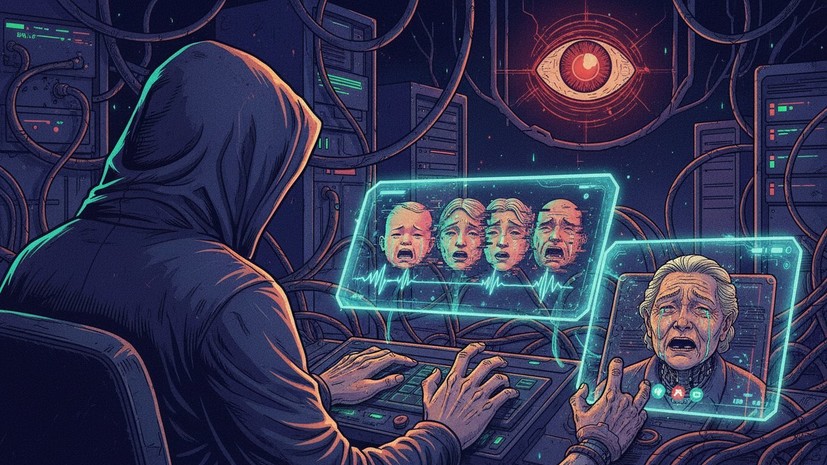

IT-эксперт Маркелов: мошенники могут подделать плач и эмоции в дипфейк-аудио

- Сгенерировано с помощью ИИ

«Во-первых, можно взять с донорского образца. Если у злоумышленника есть хоть 10—15 секунд вашего голоса в стрессе, например из сториз или записи спора, он может «перенести» эту эмоциональную окраску на любой текст», — поделился он.

По его словам, получится убедительная запись с дрожью, срывами, учащённым дыханием.

«Во-вторых, можно использовать специальные генеративные модели, которые не требуют донорского плача. Эти модели понимают текстовые метки эмоций. Мошенник может ввести инструкцию по типу «плач, истерика, шёпот», и ИИ попытается воспроизвести эту задачу, опираясь на обучающие данные», — отметил он.

Но здесь есть нюанс, ведь чем экстремальнее эмоция, тем выше риск, что голос получится «пластиковым» или с артефактами, пояснил Маркелов.

Поэтому профессиональные мошенники предпочитают всё же работать с примером голоса жертвы, так как качество выше, добавил специалист.

«При подозрительном звонке в идеале нужно потребовать назвать «стоп-фразу» — это заранее оговорённое слово, которое знают только оба собеседника. Также можно перезвонить на известный номер», — посоветовал он.

Ранее IT-эксперт Владимир Зыков пояснил, какие домены чаще используют мошенники.